Una buena política pública está necesariamente basada en el uso de evidencia imparcial e independiente en la toma de decisiones. Cuando la evidencia está contaminada o es arbitraria, nada nos garantiza que las políticas públicas ejecutadas por el Estado sean adecuadas o defendibles.

Existen situaciones aún más preocupantes que aquellas en las que el Estado utiliza evidencia sesgada, incompleta, o parcial. Me refiero, en particular, a ocasiones en las que órganos del Estado activamente generan evidencia falsa con el fin de justificar sus acciones. Ésta es la situación que enfrentamos: integrantes de la administración pública de la Ciudad de México han utilizado plataformas de la comunidad científica internacional para difundir información falsa sobre la eficacia de posibles tratamientos contra el covid-19.

Ilustración: Víctor Solís

Empecemos con algunos hechos: a casi dos años del inicio de la pandemia, no se ha encontrado ni una cura ni un tratamiento altamente efectivo contra el covid-19. Aunque muchos compuestos muestran ser eficaces en pruebas de laboratorio, existen sólo un puñado de tratamientos reconocidos por autoridades de salud. Aun estos tratamientos son controversiales y tienen una eficiencia limitada: los anticuerpos monoclonales que tenían efectos terapéuticos hace un año han perdido su poder ante las nuevas variantes del virus; los nuevos tratamientos antivirales tienen un efecto modesto en la reducción de riesgos de hospitalización y muerte. Las mejores políticas públicas sobre covid-19 continúan siendo invertir en vacunas, pruebas rápidas accesibles, el aislamiento de casos positivos, y mantener situaciones de baja densidad en espacios públicos ampliamente ventilados.

Ante la falta de tratamientos efectivos, muchos han depositado su esperanza en medicamentos aprobados para otras enfermedades desde hace décadas. La ivermectina es un ejemplo. Usada para el tratamiento de lombrices intestinales en animales y humanos, la ivermectina ha sido falsamente presentada como un tratamiento milagroso contra el covid-19. Mucho de esto se deriva de resultados de laboratorio por un grupo de investigadores australianos que mostraron que la ivermectina en altas concentraciones detiene la replicación del virus. Que un compuesto sea efectivo en los tubos de ensayo de un laboratorio, sin embargo, no garantiza que lo sea en el cuerpo humano o que sirva como base de una terapia efectiva. (El cloro también detiene la replicación del virus, pero obviamente no tiene funciones terapéuticas). En el caso de la ivermectina, se requieren dosis altísimas para emular en sangre las concentraciones estudiadas en el laboratorio. Esto incrementa sustancialmente los riesgos del tratamiento: altas dosis de ivermectina están asociadas a náuseas, mareos, debilidad, hipotensión y convulsiones. La ivermectina interactúa peligrosamente con otros tratamientos, como los anticoagulantes. En casos extremos, tomar ivermectina puede incluso ser fatal.

Sorprendentemente, y a pesar de los riesgos y contraindicaciones al uso de ivermectina en casos de covid-19 (advertidos inclusive por uno de sus productores, la farmacéutica Merck), el gobierno de la Ciudad de México adoptó este tratamiento con la población capitalina. ¿Cuál es la evidencia que utilizó la Secretaría de Salud de la Ciudad de México para tratar a personas infectadas con covid-19 con un antiparasitario sin evidencia de efectividad (de hecho, explícitamente no recomendado por agencias de salud)? No queda claro, pero tratemos de reconstruir la secuencia de hechos para entender de dónde viene esta política y cómo ha sido justificada.

Lo que sabemos de varios reportajes periodísticos y entrevistas con funcionarios es que las autoridades de salud de la Ciudad de México habían anunciado un “ensayo clínico para probar un tratamiento médico en pacientes de coronavirus” desde septiembre de 2020. Dirigido por el doctor Jose Gotés Palazuelos, el ensayo clínico inicial consistía en estudiar los efectos de dos compuestos: el mesilato de camostat y el extracto herbal de Artemisia annua. Como todo ensayo clínico, éste involucraba tan sólo a 360 pacientes, los cuales tendrían seguimiento cuidadoso por médicos para evaluar riesgos y efectos del tratamiento.

En los tres meses subsecuentes, la Secretaría de Salud de la CDMX (Sedesa) cambió radicalmente de estrategia: en vez de realizar un pequeño estudio clínico dirigido por médicos y bajo estrictos controles, la Sedesa invirtió en la compra de 200 000 kits con combinaciones diversas de ivermectina, aspirina y azitromicina para distribuir entre la población general. Sin estudios rigurosos ni recomendaciones de las agencias de salud federales e internacionales, la secretaria de Salud de la Ciudad de México, Olivia Lopez, anunció la decisión como el resultado de consultar a expertos —a quienes no identificó— de “los institutos Nacional de Ciencias Médicas y Nutrición ‘Salvador Zubirán’, Mexicano del Seguro Social (IMSS), Salud de la CDMX y Secretaría de Educación, Ciencia, Tecnología e Innovación de la Ciudad de México (Sectei)”. Distribuidos a través de quioscos, los kits fueron repartidos entre personas con infecciones de covid-19 confirmadas por una prueba rápida de antígenos. Para fines de enero de 2021, un medicamento no aprobado y sin evidencia de eficacia terapéutica había sido suministrado a más de 50 000 capitalinos sin ningún control o seguimiento riguroso.

Los kits de la Sedesa ya no eran parte de un ensayo clínico, sino que fueron una intervención pública experimental, arbitraria y altamente peligrosa: un “ahí se va” del gobierno capitalino. Por diseño, los ensayos clínicos con los que medimos la eficacia de medicamentos y tratamientos son increíblemente detallados, controlados y regulados. Los pacientes que participan de un ensayo clínico tienen que ser evaluados individualmente para garantizar que cumplen con ciertos parámetros de inclusión. El tratamiento es aleatorio y, generalmente, ni investigadores ni pacientes saben quién está recibiendo la medicina y quién el placebo. Los ensayos son registrados con agencias del gobierno —en México la Comisión Federal para la Protección contra Riesgos Sanitarios (Cofepris)— e indican meticulosamente el análisis y manejo de datos, el seguimiento a participantes y los procedimientos de inclusión y de consentimiento informado. Los kits distribuidos por Sedesa, sin embargo, no cumplían estas características. De hecho, ni la página de Cofepris ni la de ensayos clínicos del gobierno de los Estados Unidos tienen registro alguno de la intervención del gobierno de la CDMX (la Cofepris sólo tiene registro de dos ensayos de ivermectina de 2016 y 2017).

Hacia comienzos de 2021, la evidencia de la ineficacia de la ivermectina para el tratamiento del covid-19 era cada vez más clara entre la comunidad científica nacional e internacional (véase también aquí y aquí). Las críticas siguieron. ¿Cómo habría de justificar el gobierno de la Ciudad de México sus acciones irresponsables? De forma preocupante, las autoridades del gobierno de la ciudad defendieron la entrega de los kits usando un análisis propio que, según los autores, mostraba la eficacia de la ivermectina en reducir hospitalizaciones. En mayo de 2021 el jefe de la Agencia Digital de Innovación Pública, José Merino, presentó un pequeño artículo, firmado por él y por otros funcionarios, como evidencia contundente apoyando las acciones del gobierno capitalino. (El estudio fue publicado en la página SocArXiv, una plataforma que permite a científicos sociales compartir artículos que no han sido corroborados —peer-reviewed— por colegas; hasta la fecha, el artículo no ha sido publicado en una revista arbitrada de prestigio, lo cual es extraño dado el resultado que reportan. Tras discusión del consejo directivo de SocArXiv a raíz de mi crítica en Twitter, el artículo fué retirado de la página el día 4 de febrero de 2022).

Queda poco claro por qué José Merino —el jefe de una dependencia cuyas atribuciones son supervisar y coordinar políticas de gestión de datos y la infraestructura del gobierno de la Ciudad de México— se volvió el centro de la conversación sobre políticas de salud en la capital (aunque sabemos por sus redes sociales que ha sido, desde hace tiempo, un defensor de la ivermectina). Posiblemente se deriva de su liderazgo en el estudio de 2021 que aparece prominentemente en la página de la Sedesa.

Fuente: Sedesa

Escrito por José Merino (autor principal), Victor Hugo Borja, Oliva López, Eduardo Clark y otros funcionarios capitalinos, el estudio trató de replicar las condiciones experimentales de un ensayo clínico a través de varias técnicas estadísticas. Dado que los kits de ivermectina no fueron distribuidos de forma aleatoria y controlada, Merino y sus coautores usaron una técnica de “pareo” para comparar las tasas de hospitalización de aquellos que recibieron tratamientos de ivermectina y aquellos que no. El “pareo” consiste en comparar el efecto de los kits en “personas similares” en la base de datos. Específicamente, el análisis comparó la probabilidad de hospitalización entre personas del mismo sexo y con edades, síntomas y comorbidades similares. Con este método, los autores encontraron un impacto significativo de los kits sobre la probabilidad de hospitalización.

Desafortunadamente, el estudio presentado por Merino y compañía no es un esfuerzo riguroso ni mucho menos científico. En primer lugar, este tipo de estudios “observacionales” no permiten distinguir si un tratamiento es la causa de un efecto. Sin ensayos aleatorios y controlados, es simplemente imposible afirmar que los efectos reportados (la disminución de hospitalizaciones) son realmente productos del tratamiento o resultan de alguna otra variable que no fue considerada. Por ejemplo, no sabemos si variaciones en los recursos socioeconómicos de las personas —fuertemente asociados a riesgos de hospitalización y muerte por covid-19— moderaron quienes aceptaron los kits y quienes no. Los kits también incluían dosis de aspirina y, dada la intervención y el análisis, es imposible saber si las reducciones en hospitalizaciones fueron el efecto de la aspirina, de la ivermectina, o del diseño gráfico del kit. En efecto, no existe ningún órgano regulador en materia de salud en el mundo que aceptaría este tipo de estudios como evidencia de la eficacia de un medicamento. Usarlo para justificar acciones en la Ciudad de México es, de menos, irresponsable.

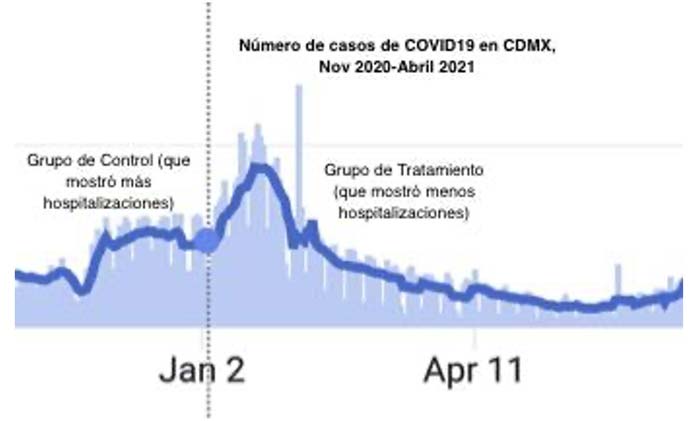

Segundo, el diseño del “cuasi-experimento”, como el artículo se refiere a la intervención, es fundamentalmente preocupante: para “parear” a las personas que recibieron o no los kits, Merino y colegas usaron información de dos momentos muy diferentes en la pandemia. Las personas que no recibieron kits (el grupo de control) fueron identificadas como aquellos con pruebas positivas de covid-19 entre noviembre y diciembre de 2020; en tanto que el grupo de tratamiento fue tomado como aquellas personas que dieron positivo en enero de 2021 y que, asumen los autores, recibieron el kit. Esto es un problema básico de datos y estadística, de comparar peras y naranjas. Además de que el estudio no garantiza que aquellos que recibieron los kits en enero de hecho siguieran el tratamiento correctamente (algo que los ensayos clínicos reales suelen monitorear), las condiciones del sistema de salud pública eran muy diferentes entre diciembre de 2020 y enero de 2021. No sabemos, por ejemplo, si la reducción de hospitalizaciones, lo único que midieron Merino y sus coautores, se debió a cambios en criterios de admisión por parte de médicos (los cuales, lejos de ser objetivos y universales, varían por hospital y a lo largo del tiempo); a presiones sobre el sector salud; al automonitoreo por parte de los pacientes; o algún otro fenómeno relacionado con el grave aumento de casos a principios de 2021. Por si esto fuera poco, un análisis del IMSS publicado en su revista oficial muestra que los kits de ivermectina de hecho no tuvieron efectos significativos en mortalidad, contradiciendo el análisis de Merino y sus colegas.

Elaboración propia con cifras públicas de contagios e información de Merino y otros.

El estudio de Merino y compañía, entonces, no sólo es engañoso —pues presenta un análisis estadístico que no permite establecer relaciones de causalidad como una base adecuada para políticas públicas— sino también inmoral. El hecho de que los autores (que incluyen a la secretaria de salud de CDMX, Olivia Lopez) hayan escrito un estudio observacional muestra que, desde un principio, no había interés en hacer una intervención rigurosa ni en recolectar el tipo de datos que permitiría un análisis más detallado. Aún más, en el artículo publicado por Merino y coautores queda claro que la intervención no contó con un protocolo claro y transparente sobre consentimiento informado. Las ciudadanas y los ciudadanos de la CDMX fueron expuestos a un experimento que no contaba con su aprobación o su consentimiento, y que tampoco seguía en lo más mínimo normas éticas de experimentación en humanos. En este sentido, el “cuasi-experimento” del gobierno de la ciudad recuerda los infames experimentos clínicos para tratamientos de sífilis que realizó el gobierno norteamericano con poblaciones marginalizadas en Tuskegee, Alabama.

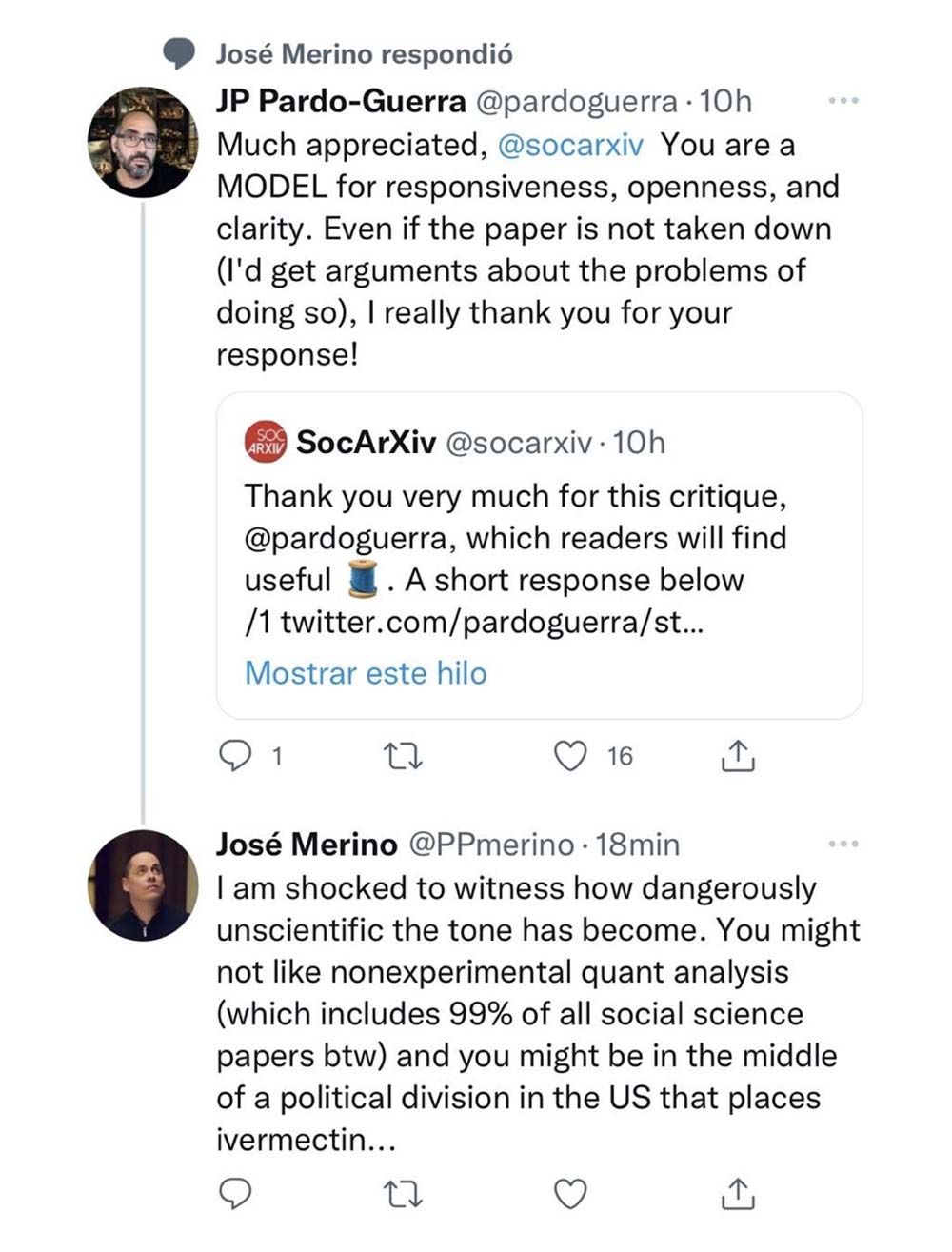

Pero aún más preocupante: valiéndose de la complejidad de las metodologías estadísticas y del desconocimiento de éstas entre el público general, el artículo se presenta como una contribución científica robusta, tanto así que es la única evidencia que ofrece la Sedesa en su página. En respuesta a un petición para retirar el artículo de la página de SocArXiv, por ejemplo, Merino denunció dicha acción como “anticientífica” y “anti-cuantitativa”, añadiendo que respondía a discusiones políticas sobre la ivermectina que no conciernen a la población capitalina.

¿Qué es lo que tenemos aquí? La historia de una acción injustificable que fue justificada con un análisis falso y arbitrario disfrazado de ciencia. La realidad es que el artículo de Merino y coautores no sólo es mala ciencia, sino es una fuente de evidencia engañosa. Haciendo uso de las infraestructuras de publicación de la comunidad científica internacional, tales como SocArXiv, los autores han circulado argumentos falsos sobre la eficacia de la ivermectina en el país y en el exterior. El artículo de Merino, equivocado en su diseño y análisis e inmoral en su forma de producir datos, ha sido descargado más de 11 000 veces y es frecuentemente citado en páginas de afiliación dudosa: de antivacunas, de organizaciones privadas que venden tratamientos alternativos contra el covid-19 y otros rincones nefastos de internet.

El artículo es tan cuestionable que generó una respuesta del portal SocArXiv, que inicialmente lo describió como una contribución de “muy baja calidad”, en el mejor de los casos, o un artículo “falso y deliberadamente engañoso”, en el peor. El hecho de que al menos uno de los autores haya recibido entrenamiento en procedimientos éticos en investigación y los límites del método de pareo en estudios observacionales (un tema estándar en clases de metodología estadística como las que Merino cursó en New York University) hace pensar que es lo segundo. Merino y colegas usaron las formas, lenguajes y plataformas de la comunidad científica para producir un engaño que circula bastante y que, en cada descarga, dañó cada vez más la base de evidencia necesaria para un buen gobierno.

El resultado es que, el 4 de febrero SocArXiv decidió retractarse del artículo, cosa casi sin precedente. Desafortunadamente, el daño está hecho: aunque fue retirado de la página, el engaño permanece vivo en internet, justificando acciones inmorales y peligrosas del gobierno capitalino.

Juan Pablo Pardo-Guerra

Profesor de sociología en la Universidad de California en San Diego

El autor vincula a una publicación del IMSS que «muestra que los kits de ivermectina de hecho no tuvieron efectos significativos en mortalidad, contradiciendo el análisis de Merino y sus colegas». Lo que no dice el autor es que (a) el análisis de Merino y sus colegas no evaluó los efectos sobre la mortalidad, sino sobre la hospitalización; y (b) el análisis del IMSS encuentra una reducción estadísticamente significativa en el riesgo de hospitalización. Es decir que ese análisis confirmó, no contradijo, el análisis de Merino y coautores (aunque no enfatizó, como hicieron Merino y coautores, el efecto específico de la ivermectina).

Ese artículo del IMSS citado para supuestamente contradecir a Merino y coautores, por cierto, también es «observacional». De hecho, le veo muchos paralelos al de Merino y coautores. En términos de ética y calidad metodológica, me gustaría saber qué hace a ese estudio citable y no criticable (es duda genuina; me parecen muy similares pero no me consta).

En cuanto a la comparación con el infame estudio Tuskegee, eso ridícula y a mis ojos le quita seriedad y objetividad al autor.