La respuesta es sí, aunque esta práctica es poco utilizada (todavía). Pero igual debemos entender su relevancia e implicaciones.

Vayamos por partes.

¿Qué son los deepfakes? Los deepfakes son la manipulación de imágenes y videos con tecnología de punta, principalmente a través del uso de Inteligencia Artificial (IA). El primer caso conocido es de 2017, cuando un usuario anónimo de Reddit apodado Deepfakes –de ahí el nombre– publicó videos con la cara de celebridades como Scarlett Johansson en cuerpos de actrices de pornografía. Los videos se viralizaron de inmediato.

A grandes rasgos, las técnicas más comunes para manipular audios, videos e imágenes están relacionadas con lo que se conoce como machine y deep learning. Con machine y deep learning, los procesadores son capaces de interpretar grandes cantidades de información y extraer conclusiones de formas que asemejan nuestro pensamiento. La diferencia entre uno y otro radica en que las conclusiones del machine learning están limitadas por sus propios algoritmos y el deep learning tiene capas que le permiten “aprender” por medio de prueba y error, lo que acelera los procesos y reduce la necesidad de intervención humana.

Cuando se tienen herramientas capaces de aprender por cuenta propia se acelera el ritmo de adopción en distintos entornos. Antes se necesitaba que alguien estuviera supervisando el proceso completo de generación de imágenes falsas. Hoy en día la misma herramienta puede crear cientos o miles de videos, de lo cuales algunos resultarán muy “reales”. Después de pocos ciclos, este aprendizaje hará que pueda crear videos “realistas” en ocasiones subsecuentes sin mayor problema, sin supervisión y sin corrección de un humano. Con algunas fotos las neuronas digitales serán capaces de hacer el resto.

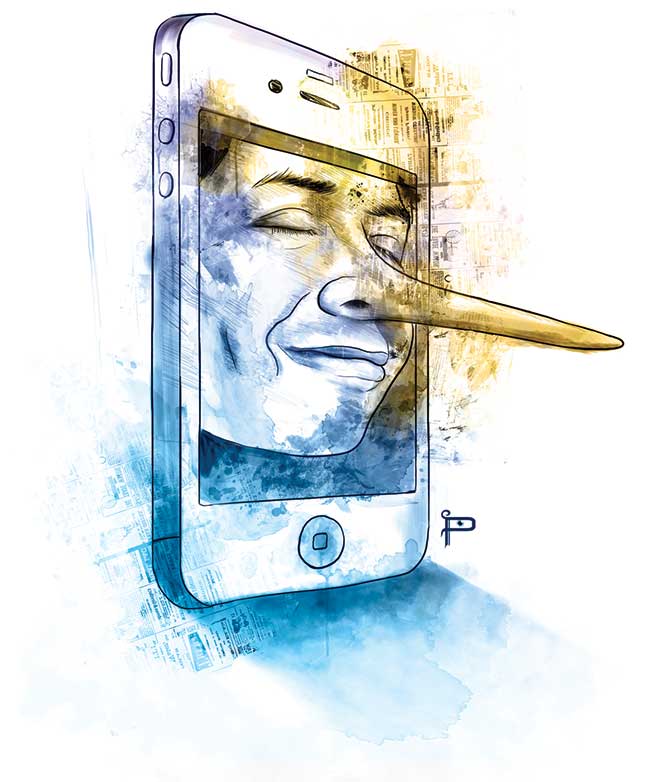

Ilustración: Guillermo Préstegui

Ahora bien, ¿por qué nos deben preocupar los deepfakes?

Principalmente porque son una herramienta muy poderosa para generar desinformación o noticias falsas. Como explica Wardle (2017), las noticias falsas son un concepto amplio. Las imágenes, el audio y el video no están excluidos de este tipo de usos y en comparación con la información escrita, el audio y la imagen tienen una mayor capacidad de engañar a las personas. Esto se debe principalmente a que nuestro cerebro procesa las imágenes más rápido que el texto y somos menos críticos con las imágenes y los videos que con los textos, según Wardle. Además, los algoritmos de las redes sociales —particularmente Facebook— favorecen las imágenes y los videos en lugar del texto. Con la tecnología existente es posible manipular contenido con motivos y propósitos maliciosos a gran escala y llegar a millones de personas en cuestión de segundos.

En general, la generación de videos o audio mediante IA puede afectar la reputación de una persona. Imaginemos el impacto de un video falso de un político aceptando un soborno o alguien involucrado en un escándalo sexual que nunca sucedió. Pero eso no es todo, el engaño generado por los deepfakes tiene implicaciones más profundas que pueden dañar la democracia o incluso nuestros sistemas de creencias en general.

Si los deepfakes siguen ganando tracción, en un momento determinado la cantidad información hará imposible que los no expertos identifiquen qué es real y qué no. “Ver para creer” pronto podría convertirse en “ver para no creer”. Eso puede llevar a lo que Ovadya llama "apatía de la realidad": después de una avalancha de información falsa, la gente podría comenzar a rendirse y dejar de prestar atención a las noticias. En una sociedad en la que los hechos se vuelven cada vez más cuestionables o casi imposibles de distinguir de la desinformación, el "vértigo de la realidad" ocasionaría confusión ya que las computadoras pueden generar contenido tan convincente que la gente común puede tener dificultades para descubrir qué es verdad.

En un su libro Deepfakes: The Coming infocalypse, Schick menciona que los deepfakes pueden amplificar aún más la desinformación, confusión y la mentira incluso en sociedades democráticas en donde líderes como Trump recurren a sus propias fuentes o desacreditan a la ciencia o los hechos cuando se critica posturas contrarias a sus fines personales o políticos. Este tipo de práctica no es aplicable sólo a Donald Trump, sino también a otros líderes del mundo que, con sus “propios datos”, deslegitiman a instituciones, periodistas o a la ciencia. Los deepfakes se convierten así en una herramienta muy poderosa para definir agenda, dominar la conversación o generar ruido con fines de confusión y distracción para temas que el líder considere pertinentes. Como Schick menciona al parafrasear a Arendt, no importa si el líder miente si las personas piensan que todo ya es una mentira.

El presidente Trump ha demostrado interés en compartir videos y material audiovisual manipulados durante su mandato. Por ejemplo, desde su cuenta de Twitter compartió un video manipulado de Joe Biden donde el último supuestamente comparte en su celular un rap de N.W.A, "F— that Police”, cuando en realidad estaba escuchando la canción de “Despacito”. Otro ejemplo muy conocido ocurrió cuando se editó un video para que el corresponsal de CNN en la Casa Blanca, Jim Acosta, “agrediera” a una pasante del equipo de Trump al pasarle el micrófono. Ese video editado hizo que el gobierno le restringiera acceso al corresponsal hasta que su falsedad fue demostrada.

Ahora bien, académicos, periodistas, defensores de derechos humanos e incluso grandes compañías están llevando a cabo esfuerzos para detectar y contrarrestar esta práctica. Algunos van desde prohibirlos en sus plataformas, como Pornhub o Reddit, otros como Microsoft o Facebook, por medio de su tecnología, detectan e informan a los usuarios si un video es falso. Además, proyectos como First Draft News de Harvard o Google News Initiative están capacitando a periodistas y profesionales de los medios para abordar el trastorno de desinformación y proporcionando recursos educativos. Este artículo en Medium concentra una lista completa de otras iniciativas periodísticas para abordar las “noticias falsas”.

La manipulación de videos, imágenes y audios no es aún una práctica masiva. Sin embargo, comienza a conocerse y a utilizarse más. En el contexto mexicano pareciera que no se habla o estudia mucho del tema pero tendremos unas elecciones sumamente importantes el próximo año, y las de 2024 lo serán más. Las nuevas técnicas de manipulación digital podrán jugar un papel relevante en ambos comicios. Es buen momento para profundizar y actuar en torno a los retos que nos presentan los deepfakes. Sería buenono subestimarlos.

José Alfaro y Marcelo Torres